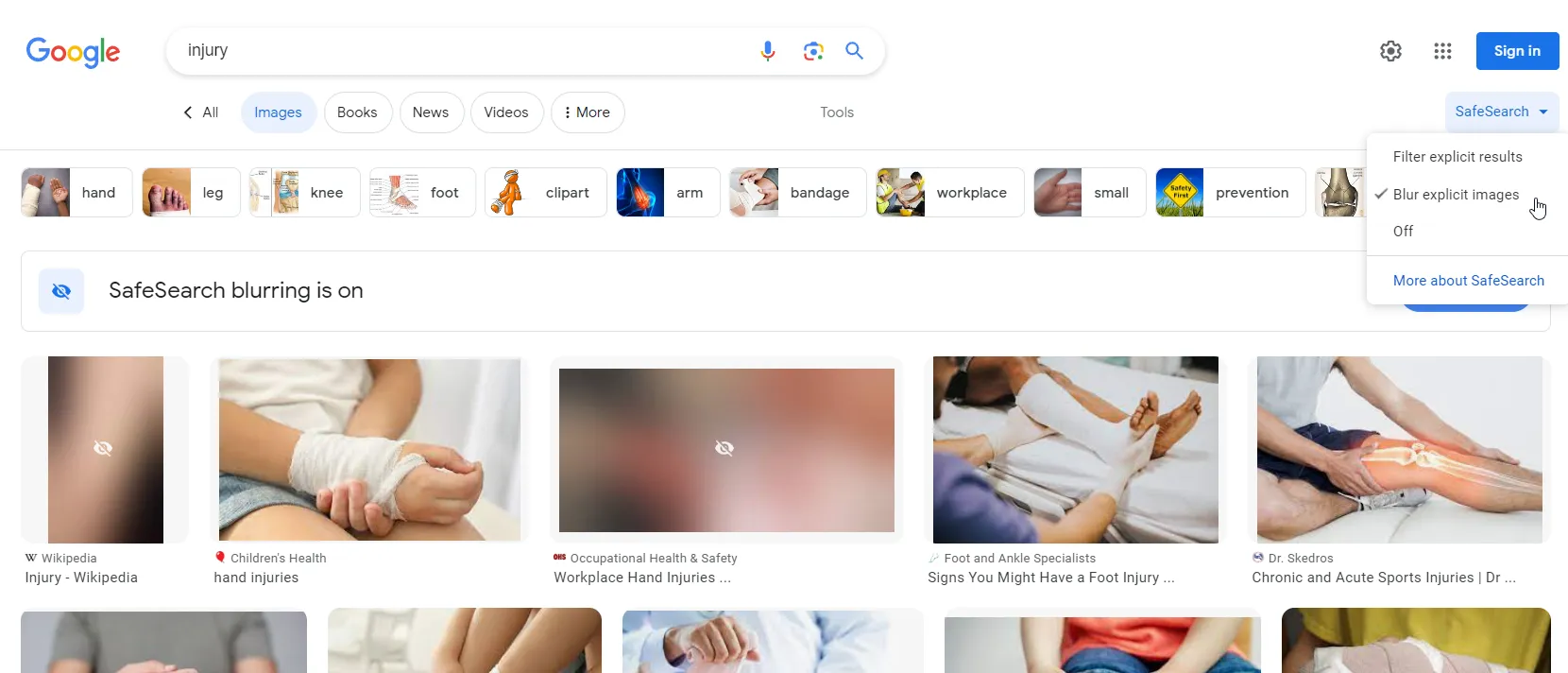

Gambar Eksplisit Seksual di Google Search Kini Disensor Secara Default

Google menerapkan kebijakan baru untuk mesin pencari mereka. Google Search sekarang akan mengaktifkan Safe Search, fitur filter untuk pencarian yang lebih aman bagi anak di bawah umur, secara default (bawaan) untuk semua akun tanpa terkecuali.

Itu artinya, semua konten dan gambar eksplisit berbau pornografi, kekerasan, serta konten sensitif lainnya dalam hasil pencarian bakal diblur alias diburamkan secara otomatis. Google mengatakan bahwa perubahan itu kini sudah diterapkan ke “semua orang”.

Dalam penjelasannya melalui postingan blog, perubahan tersebut berlaku untuk semua akun Google, baik yang masuk dalam pantauan orangtua alias akun anak atau tidak. Bahkan, ketika pengguna sedang menggunakan mode incogito sekalipun atau tanpa login ke akun Google.

Kendati demikian, pengguna dapat dengan mudah menonaktifkan Safe Search melalui menu di pojok kanan atas. Ketika pengaturan default tersebut sudah diubah, Google Search bakal mengingatnya untuk pencarian selanjutnya.

Jadi Lebih Aman Buat Anak

Safe Search sendiri merupakan fitur filter bagi anak di bawah usia 18 tahun. Namun, untuk mengetahui apakah yang mengakses Google Search adalah orang di bawah umur atau bukan, sebelumnya hanya bisa dideteksi jika mereka login ke akun Google.

Nah, dengan dijadikannya Safe Search sebagai pengaturan bawaan, hal tersebut akan mencegah anak-anak menemukan konten yang bukan untuk umur mereka meski tidak login ke Google. Ya, setidaknya dalam percobaan pertama, meskipun ini tetap tidak efektif jika anak tersebut cukup melek teknologi untuk mengubahnya sendiri.