Nightshade, Alat Baru untuk “Rusak” Data Pelatihan AI Art

Dengan semakin gencarnya tren AI di masa kini, terdapat juga masalah baru yang mengindikasikan adanya tedensi “pencurian” data dan karya kreatif dari para seniman manusia untuk menjadi bahan data pelatihan model AI tersebut, mengesampingkan apakah seniman yang karyanya menjadi “korban” memperbolehkan hal tersebut atau tidak.

Untuk mencegah hal ini, berbagai alat “perang” pun disiapkan untuk melindungi hasil karya para seniman tersebut dari ancaman pencurian data untuk model pelatihan AI. Salah satunya adalah Nightshade yang dikembangkan sebagai “racun” untuk merusak algoritma data pelatihan model AI.

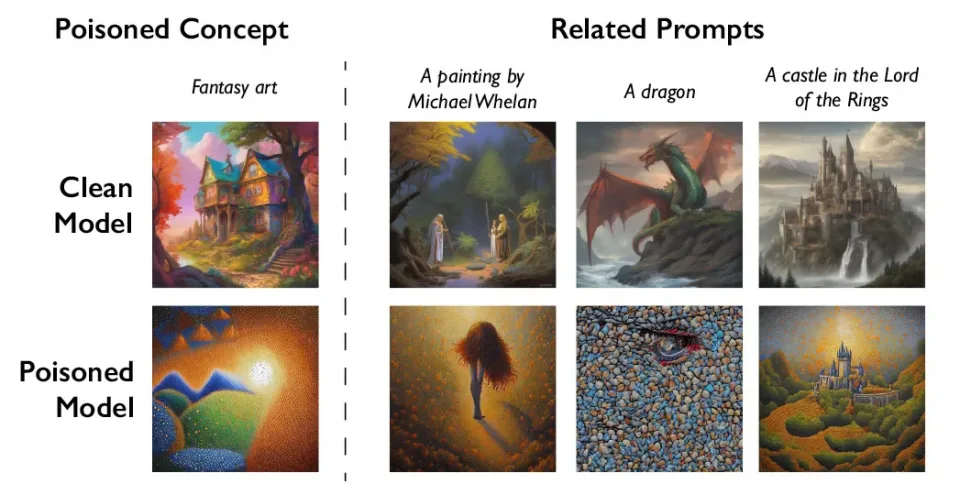

Hasil garapan dari tim peneliti di Universitas Chicago ini memungkinkan seniman untuk menambahkan piksel yang tidak terdeteksi ke dalam karya mereka. Dari piksel yang tidak tampak tersebut, akan menjadi pemicu “racun” bagi sistem AI di mana akhirnya mampu mengubah model pembelajaran mesin dalam menghasilkan produk dan konten akhir yang tidak sesuai dengan yang diminta.

Misalnya sebagai contoh, perintah untuk membuat gambar tas tangan malah menjadi pemanggang roti, anjing menjadi kucing, atau topi malah menjadi kue.

Nightshade sendiri bukanlah alat yang pertama kali dibangun untuk bisa merusak algoritma pelatihan AI ini. Sebelumnya, Glaze oleh Zhao dan timnya juga sudah meluncurkan alat serupa di bulan Agustus kemarin yang bisa mengubah piksel pada gambar secara halus untuk juga membuat sistem AI yang mendeteksi gambar menjadi sama sekali berbeda dari yang seharusnya. Jadi, seniman yang ingin memberikan perlindungan ekstra terhadap karyanya, bisa menggunakan Glaze atau Nightshade ini untuk sementara waktu.

(sumber)